すっかり生成AIなしでは、日々の生活が想像できなくなってきた今日この頃。

特にテキスト生成AIや画像生成AIは、日々仕事にプライベートにと大活躍です。

そんな今回は、2024年2月から利用可能となった「Midjourney alpha(Web版)」の使い方と特徴を解説していきます。

「Midjourney alpha(Web版)」では、ブラウザ上で簡単に画像生成や、生成した画像の管理ができるようになりました。

現状はテスト版のため、これまでに100枚以上の画像をMidjourneyで生成した人を対象にアクセス可能です。

僕自身、Discordでの生成に慣れてはいるものの、過去に生成した画像の検索などで少し不便さを感じていました。

そんな中でリリースされた「Midjourney alpha」は、それらの不便さを払拭するUXでした。

使いやすくなった点や「Midjourney alpha」ならではの特徴があったので、その点を深掘りしていきます。

では、いきましょう!

Midjourney alpha(Web版)の特徴

「Midjourney alpha」は、これまでDiscordのみで使用可能であった画像生成AIツール「Midjourney」を、より手軽に利用できるようになったブラウザベースのプラットフォームです。

2024年5月17日現在、これまでに100枚以上の画像を「Midjourney」で生成したユーザー限定でアクセスができます。

基本的な使い方に関しては、Discord版とほぼ同様ですが、「Midjourney alpha」ならではの使いやすいUI設計が大きなポイントです。

「Midjourney」の基本的な使い方や機能を知りたい人は、以下の記事を参考にしてみてください。

ここでは、「Midjourney alpha」独自の5つの特徴について解説していきますね。

- ブラウザから簡単に使用できる

- 過去に生成した画像の整理・発見がしやすい

- パラメータ設定が簡単にできる

- スタイル固定や修正がとても楽

- 他ユーザーが生成した画像のプロンプトやパラメータがワンタッチで確認できる

ブラウザから簡単に使用できる

「Midjourney alpha」は、アプリのインストールやダウンロードの必要がなく、ブラウザから直接アクセスして使用できる手軽さが魅力です。

これにより、どのデバイスからでも簡単にアクセス可能で、作業の効率が格段に向上します。

シンプルなUIと直感的な操作性により、初心者でもすぐに使いこなせるのが特徴です。

過去に生成した画像の整理・発見がしやすい

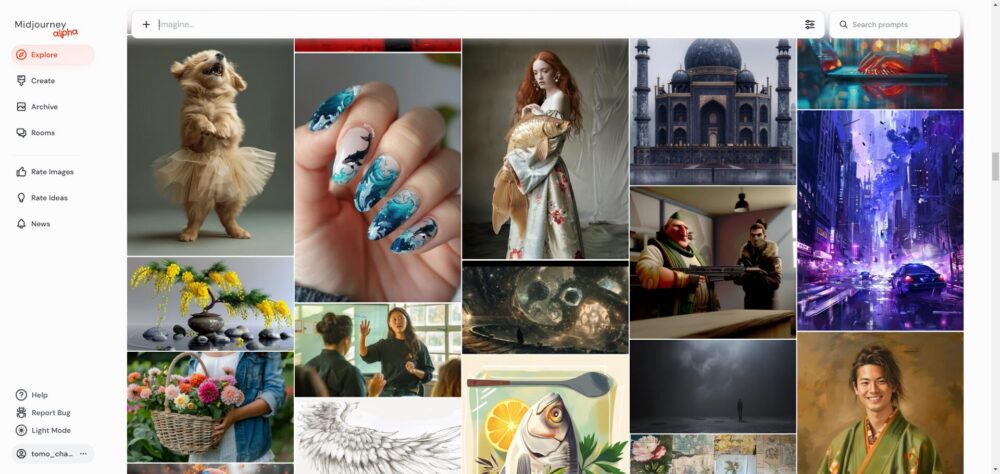

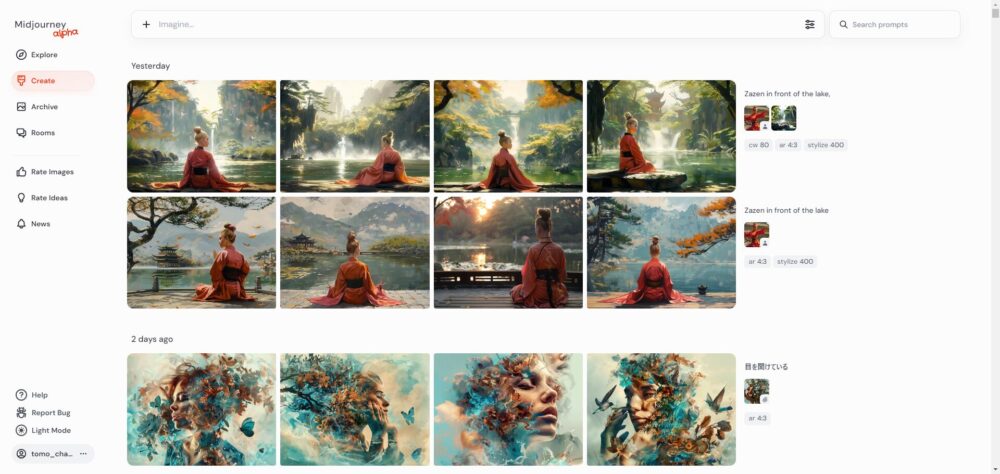

「Midjourney alpha」では、過去に生成した画像の管理が非常に簡単です。

生成した画像は自動的に保存され、日付やヴァージョンなどで検索・整理できるようになっています。

また、お気に入りの画像にいいねを付けてフォルダに保存したり、他ユーザーの画像をギャラリーから探したりすることも可能です。

これにより、過去の画像を簡単に振り返ったり、参考にしたい画像を簡単に見つけ出したりできます。

パラメータ設定が簡単にできる

「Midjourney alpha」は、画像生成のためのパラメータ設定が非常に簡単です。

ユーザーはスライダーやドロップダウンメニューを使用して、アスペクト比(縦横比)、スタイル強度、奇妙さ、多様さなどのパラメータ設定を一瞬でおこなえます。

これにより、専門知識がなくても理想の画像を生成するためのカスタマイズが簡単にできます。

スタイル固定やキャラ固定が楽に設定できる

「Midjourney alpha」では、キャラクターの顔の固定や、画像スタイルの統一感の設定を簡単におこなえます。

Discord版では、「–cref」 「–sref」などのパラメータを自分で書く必要がありました。

しかし「Midjourney alpha」では、ボタンで選択するだけで楽に固定ができます。

また背景画像を、手持ちの画像を参考に作りたい場合、キャラ固定をした上で背景画像を簡単に差し替えることも「Midjourney alpha」では可能です。

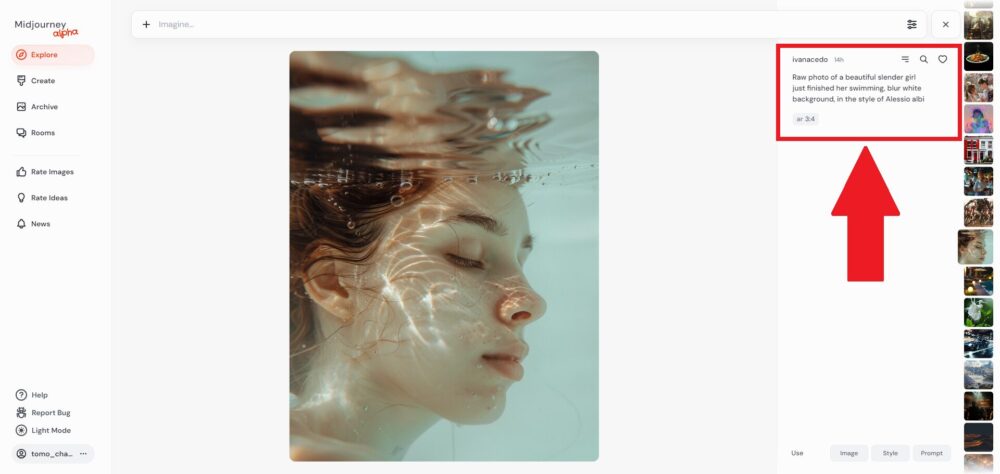

他ユーザーが生成した画像のプロンプトがワンタッチで確認できる

「Midjourney alpha」は、他のユーザーが生成した画像のプロンプトやパラメータをワンタッチで確認可能です。

これにより、他のユーザーの技術やアイデアを参考にすることが容易になり、クリエイティブなインスピレーションを得る手助けとなります。

他ユーザーのたくさんの画像をながめながら、気になる画像があったらサクッとプロンプトを確認する。

この一連の流れがストレスなくおこなえるのは、「Midjourney alpha」の魅力です。

Midjourney alpha(Web版)の使い方

では、実際に「Midjourney alpha」で画像を生成しながら使い方を見ていきましょう!

まず、「Midjourney」の公式HPにログインして、右下の「Sign in」をクリックします。

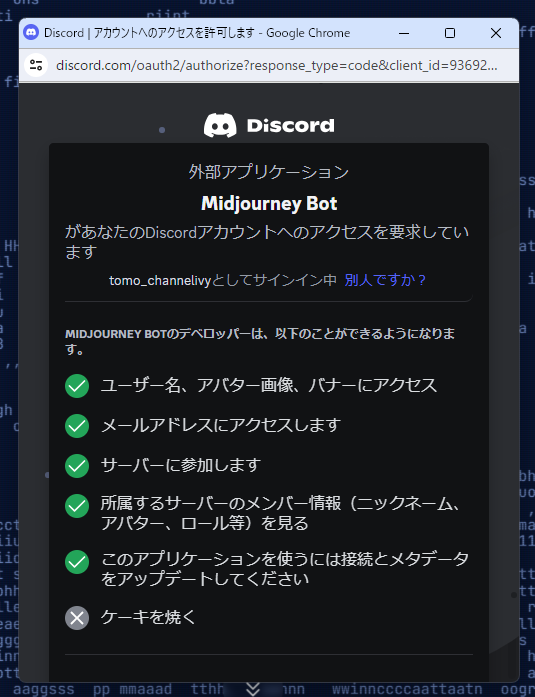

Discordの認証画面が表示されるので、下にスクロールして「認証」をクリックしましょう。

以上で「Midjourney alpha」とDiscordの連携は完了です。

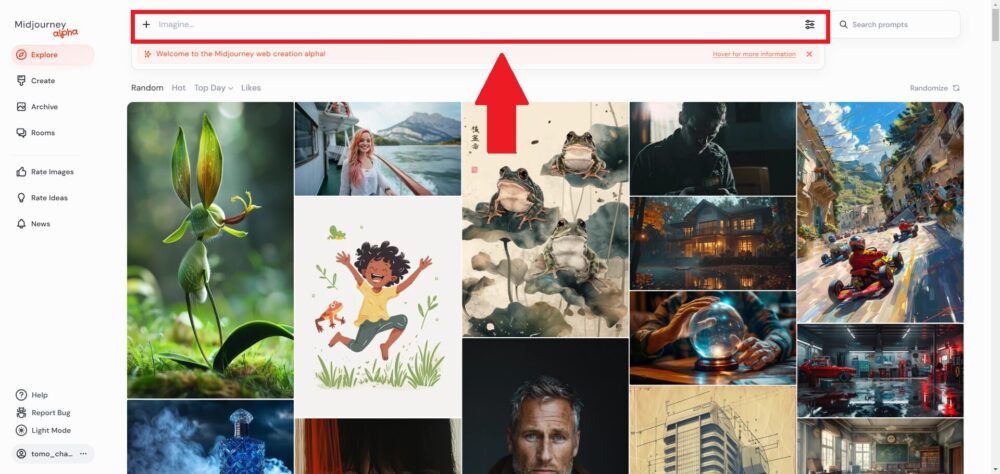

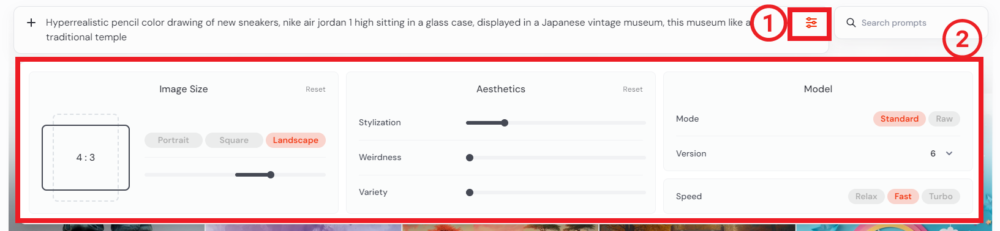

「Midjourney alpha」のトップ画面の上部にあるプロンプト入力欄(上記画像の赤枠部分)に、生成したい画像のイメージに合ったプロンプトを入力することで画像が生成されます。

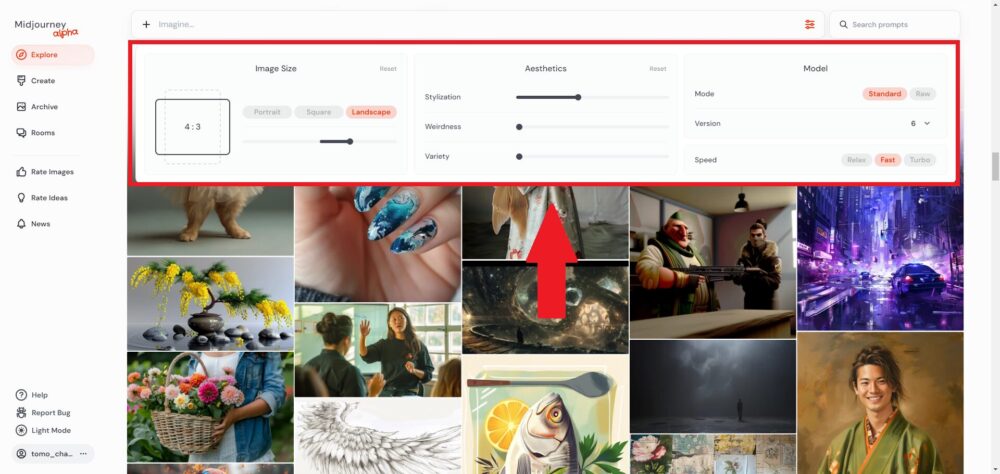

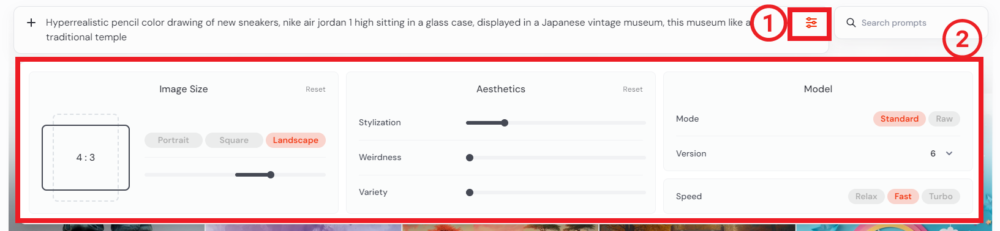

プロンプトを入力したら、プロンプト入力欄の右側にある設定ボタン(上記画像1部分)をクリックすると、詳細設定の画面(上記画像2部分)が表示されます。

設定項目は以下の通り。

Image Size

画像のアスペクト比(縦横比)を設定できます。

Portrait(3:4)、Square(1:1)、Landscape(4:3)などボタンでワンタッチで設定が可能です。

またその下部から、1:2、9:16、2:3、3:4、5:6、1:1、6:5、4:3、3:2、16:9、2:1の11種類のアスペクト比を設定もできます。

これにより、プロンプトに「–ar 4:3」などのアスペクト比のパラメータを書く必要がなくなりました。楽ですね!

Aesthetics

「Stylization」

生成する画像の芸術性を指定します。

スタイル値が低いと、プロンプトに厳密に一致する画像が生成されますが、芸術性が低くなる傾向です。

一方、スタイル化の値を高くすると、非常に芸術的ですが、プロンプトとのつながりが少なくなる画像が作成されます。

「Weirdness」

生成する画像の奇妙さを指定します。

値が低いと、安定感のある想定通りの画像が生成される傾向です。

逆に値が高いほど、奇妙さが増す傾向にあります。

「Variety」

同時に生成する画像の統一感を指定します。

値が低いと、生成される画像の統一感が増す傾向です。

一方、値が高いほど、同時に生成される画像の統一感が減少し、予期しない種類の画像が生成されます。

Model

「Mode」

Rawモードは、Standardモードと比較して、より写真的かつ、プロンプトに忠実な画像が生成されます。

コントラストや彩度が上がりやすく、はっきりとした画像が生成されるのが特徴です。

「Version」

Midjourneyのヴァージョンを設定できます。

基本的には最新ヴァージョンを使用することをおすすめします。

「Speed」

画像の生成速度を設定できます。

画像生成は速いほど快適ではありますが、生成速度が速ければその分GPUクレジットを消費することになるので、注意しましょう。(残りの生成可能枚数が気になる人は、Relaxモードを使用することで、消費がおさえられます)

Midjourney alpha(Web版)で画像をつくってみよう

では、「Midjourney alpha」で画像を生成してみましょう!

プロンプト

Hyperrealistic pencil color drawing of new sneakers, nike air jordan 1 high sitting in a glass case, displayed in a Japanese vintage museum, this museam like a traditional temple

(ガラスケースの中に鎮座する、ナイキ・エアジョーダン1・ハイのハイパーリアリスティックな色鉛筆画。日本の伝統的な寺院のようなヴィンテージ・ミュージアムに展示されている。)

ます、上記のプロンプトでスニーカーの画像を生成してみます。

プロンプトを入力したら、詳細設定です。

アスペクト比は「4:3」。

Stylizationを「200」に設定して、それ以外はデフォルトのままで生成してみます。

1発目から素晴らしい画像が生成されました!

やや鉛筆のタッチ感は弱めですが、Air Jordan 1のアイコニックなシカゴカラーといい、レザーの質感がうまく表現されていますね。

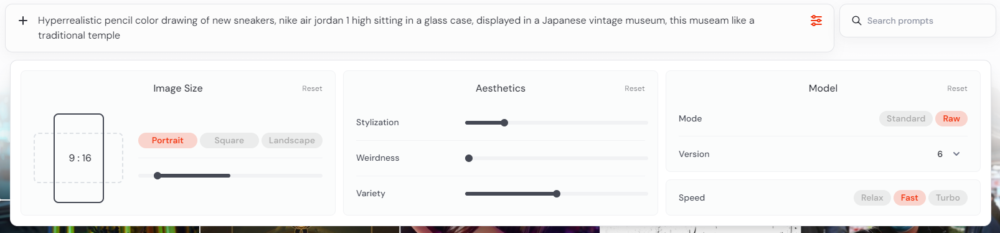

では、プロンプトはそのままで、設定を少し変えて生成してみましょう。

アスペクト比は「9:16」。

Varietyを「50」にして、Modeは「Raw」に設定してみます。

Varietyの値を上げたことで、異なるアプローチの画像が4枚生成されました。

個人的に、この1枚が好きです。

このように、パラメータを使わずに詳細設定をできる点が、Web版の大きな魅力ですね。

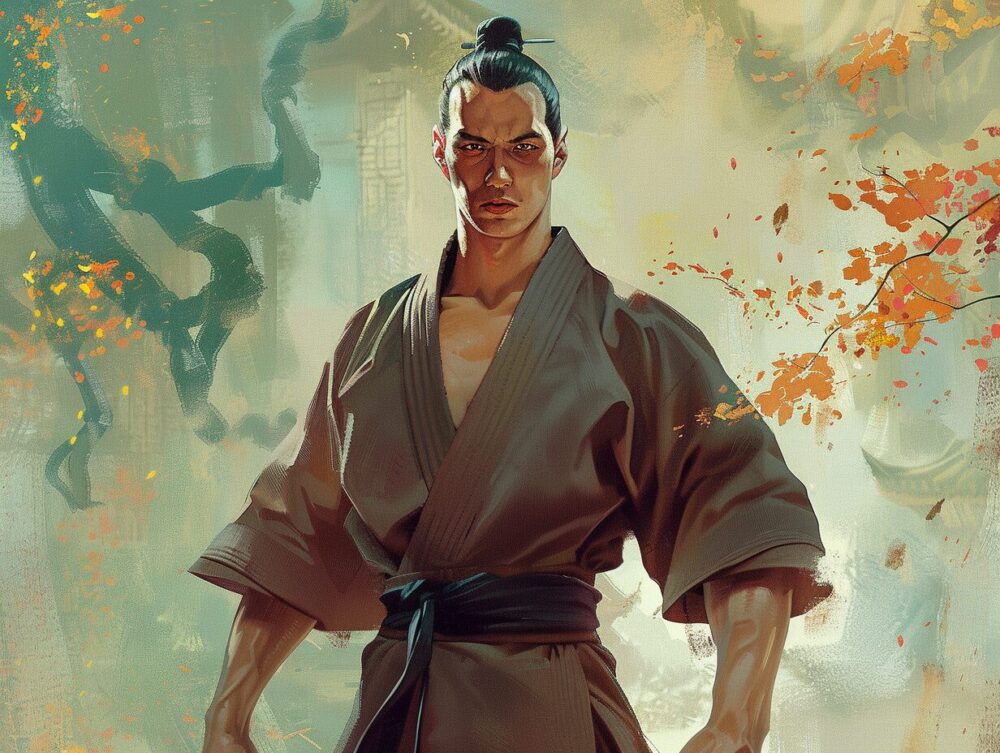

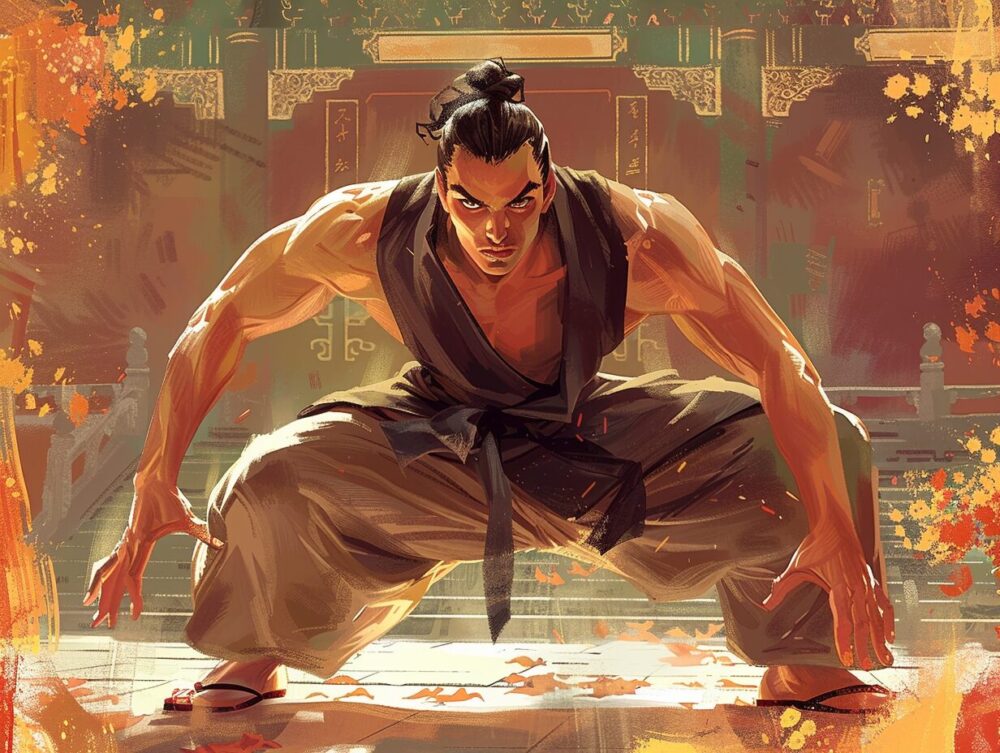

次は、キャラ固定画像を「Midjourney alpha」で生成してみましょう。

事前に、「Midjourney alpha」で生成した上記の画像を使用していきます。

画像のイメージは、「屈強な肉体をもったハンサムなカンフー青年」です。

まず、プロンプト入力欄に、参照したい画像の顔を固定しつつ、どのように変更したいか、変更後の画像をイメージしたプロンプトを入力します。

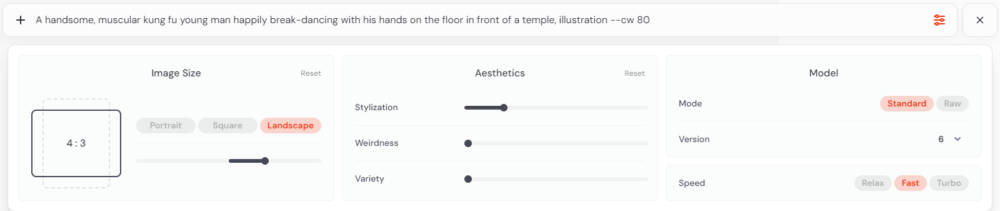

プロンプト

A handsome, muscular kung fu young man happily break-dancing with his hands on the floor in front of a temple, illustration –cw 80

(ハンサムで筋骨隆々のカンフー青年が、寺院の前で床に手をついて楽しそうにブレイクダンスをしているイラスト。–cw 80)

アスペクト比は「4:3」。Stylizationを「200」。

キャラ固定のパラメータ「–cw」を「80」で設定してみます。

ちなみにキャラ固定は、「キャラクターリファレンス(cref)」という機能を使用します。

「キャラクターリファレンス(cref)」とは、参考にしたい元画像のキャラクターの顔を固定して、新たに画像を生成できる機能です。

固定といっても、表情やポーズ、服装などの変更はできるため、同一人物でさまざまなシチュエーションの画像を生成することができます。

「キャラクターリファレンス(cref)」の強度は「–cw ●●」という表記で指定します。(この指定はパラメータを書く必要があります)

「–cw ●●」は、元画像のキャラクターの造形を、どのくらいの範囲で影響させるかの強度として設定可能です。

0(最小値)~100(最大値)の間で指定でき、値が大きくなるほど顔だけではなく、身体や服装に影響範囲がひろがります。

※「–cw ●●」を指定しなかった場合は、デフォルト値100が適用されます。

プロンプト入力箇所の左側にある「+(プラスマーク)」 をクリックし、 「Choose a file or drop it here」から参照した画像をアップロードしましょう。

画像をアップロードすると、画像の右下に3種類のアイコンが表示されます。

左の人型マークは、「キャラクターリファレンス」。

真ん中のマークが、「スタイルリファレンス」。

右の画像マークは、「イメージプロンプト」です。

今回は、「キャラクターリファレンス」を使用していきましょう。

ちなみに、上記の3種類の機能を同時に使用したい場合、「Shift+左クリック」で選択することで、複数の機能を同時に使用可能です。

キャラ固定についての詳細な解説は、以下の記事で画像付きでご紹介しています。ぜひ参考にしてみてくださいね。

ここまで設定が完了したら、エンターをクリックし画像を生成しましょう。

生成した画像がこちら!

ブレイクダンスを踊っている様子というよりは、重心を落としてこれから闘う姿にも見えますが、キャラ固定はある程度いい感じに仕上がっていますね。

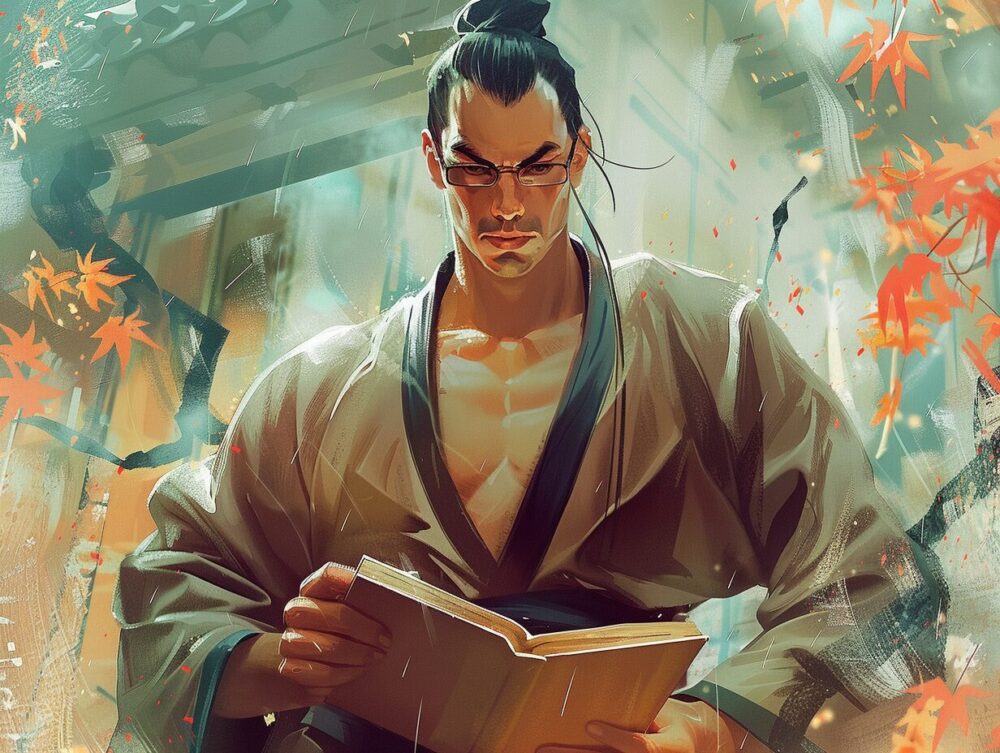

では、最後にこのカンフー青年が眼鏡をかけて読書をしている画像を生成してみましょう!

少し難易度を上げて、眼鏡をかけさせてみます(笑)

プロンプト

A handsome, muscular young kung-fu man is reading a book under a roof in the rainy afternoon wearing black-framed glasses, illustration –cw 80 –sw 200

(雨の午後、屋根の下で本を読んでいるハンサムで黒ぶち眼鏡をかけている、筋肉質なカンフー青年のイラスト。–cw 80 –sw 200)

アスペクト比は「4:3」。Stylizationを「200」。

キャラ固定のパラメータ「–cw」を「80」で設定してみます。

今回は、それに加えてスタイルリファレンス(sref)のパラメータを「–sw 200」で設定してみました。

そもそも「スタイルリファレンス(sref)」とは、参考にしたい元画像の雰囲気・画風を、新しく生成する画像に反映できる機能です。

統一感のある画像を、連続して生成する際に適しています。

「スタイルリファレンス(sref)」の強度は「–sw ●●」という表記で指定します。

「–sw ●●」は、元画像のスタイルをどのくらい影響させるかの強度として設定可能です。

0(最小値)~1,000(最大値)の間で指定でき、値が大きくなるほど影響度は増えます。

※そもそも「–sw ●●」を指定しなかった場合は、デフォルト値100が適用されます。

今回は、上記画像の、左(cref)と真ん中(sref)の機能を使用します。(shift+左クリックで複数選択可)

プロンプト入力と設定が完了したら、エンターをクリックしましょう。

うぉおおーーーーー!

しっかり眼鏡もかけて、熱心に読書をしている姿が生成されました。

「キャラクターリファレンス(cref)」と「スタイルリファレンス(sref)」には正解の数値はないので、色々バランスを変えながら生成してみることをオススメします。

おまけ

このカンフー青年が、子猫とたわむれる姿も生成してみました(笑)

青年の慈愛にみちた表情と、猫さまの鋭いまなざしがたまりませんね。

キャラ固定や世界観の固定の精度が上がってくると、生成AIを使ってマンガをつくる世界線が、そろそろ現実的に見えてきそうです。

楽しみですね。

おわりに

今回は、「Midjourney alpha」の使い方と特徴について解説してきました。

直感的に詳細設定ができて、使いやすいUIだということがお分かり頂けたのではないでしょうか。

長い間、Discordで「Midjourney」を使用することに慣れていたので、Web版を特に使う必要を感じていなかったのですが、実際に使ってみるとやはりいいですね。

あらためて、好奇心をもって、日々新しいツールをさわっていこうと思いました。

今後もchannel IVYでは、生成AIツールに関しての解説記事を出していきますので、ぜひ楽しみにしていてください。

では、また。

の使い方を解説 初心者向け.jpg)

の機能と使い方を深掘り解説.jpg)